20世紀以前,科學技術主要是用來解決人類生存問題,改善生活品質的工具。但是20世紀中葉以後,人類許多生存與社會問題卻反而來自科學技術的擴張。當2016年圍棋程式AlphaGo甚至擊敗人類冠軍時,人工智慧(Artificial Intelligence)終於公然踏入人類最深層的思想領域,且快速地應用在工商、金融、交通、治安、文化、教育、軍事等等幾乎所有領域,帶領出第四次工業革命來改變人類現今生活的面貌。唯一不能確定的是,這場改變的極限會在哪裡?為機器賦予「智慧」或許最終只是科幻小說中的情節,但是我們卻可能更多高估了自己。在各國政府與企業帶頭推廣AI相關的研究與產業之際,最不能遺忘的是AI所帶來關於人類意義與價值的挑戰。

一、問題的核心:

顧名思義,「人工智慧」是用人為設計來模擬出可堪比人類智慧(或智能)的機器。但是人們對於「智慧」該如何定義,本身就不見得有一致性的標準 。與其困擾於如何定義適當的字彙,上個世紀中數學家圖靈(Alan M. Turing)就提出了一種相當精簡但含意深刻的評估方式,至今仍廣為流傳。圖靈建議可以藉由測試某機器是否能表現出與人等價且無法區分的談話內容(限文字溝通),來確認它是否具有「智慧」,也就是著名的「圖靈測試」。不過任何思慮嚴謹的人馬上會發現,這個測試其實相當模糊,因為牽涉到要與甚麼樣的人對談?要談那些範圍?要談多久才算?等等細節。因此這種測試方式在講求實務與精確的科技浪潮中,更多只是一種象徵性的意義。

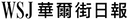

但是圖靈測試本身的核心意義,是筆者認為過往在思考AI相關影響時最重要卻最常被忽略的觀點:重點不在於「本質」是否相同,而是「果效」是否等價,並且藉由語言溝通的即時性效果來繞過對於心智的恆常性定義。也就是說真正的問題恐怕不是「AI何時可以超越人類?」或是「AI會不會擁有自我意識?」,而是應該反過來問,「人類還有多少AI無法達到的智能?」或者「人類何時會接受AI為情感的對象?」。有許多理由相信,後者出現的可能性與影響範圍恐怕還遠高於前者,更值得政府部門與有識之士的關注,也正是本文的核心主旨。

二、深度學習的特色

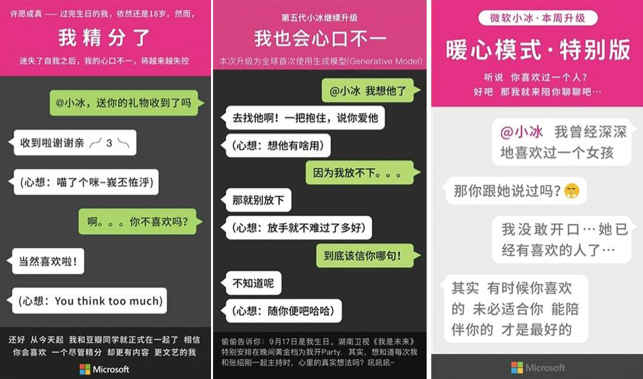

其實早從20世紀中第一代的電腦開始,與神經網路有關的人工智慧研究就已浮現,但50多年來經歷許多技術與數據上的瓶頸,甚至幾度停滯不前。最近第三波人工智慧應用的大爆發其實得力於許多機緣的結合,包括計算更為快速的處理器與累積在網路上大量的資料。其中的核心技術乃是藉由所謂「深度學習」(Deep Learning)來實現許多以前無法企及的應用(特別是在圖形辨識與競賽遊戲方面),筆者認為這次深度學習的成功在許多方面展現出圖靈測試的核心意義,以至於對人類自我的認知或價值感帶來深刻的影響,包括高準確率、自我學習與無解釋性:

1.高準確率(High Accuracy): (相關報導: 楊建銘專欄:AI真正的主戰場在硬體 | 更多文章 )

「準確率」一直是計算工程所追求的目標之一,所需要的不僅是硬體設備的先進程度,更需要有好的軟體(如計算法,algorithm)的開發。過往電腦的基本運算速度雖然早已完全超越人類,但基本上都是需要程式設計師將想要完成的工作化為一行行以數值運算為基礎的程式語言來讓電腦執行。但是如果要實踐真正的人工智慧,顯然電腦要有能力回應人類生活中更多無法結構化、數值化或程式化的動作,這也是過往人工智慧最大的挑戰。