人工智慧和機器學習有賴於很多人的大規模辛勤工作。

除了科學家,還有成千上萬的低收入工作者,他們的工作是對數據進行分類和標記——這是人工智慧這類系統的生命線。

但越來越多人質疑,這些所謂的「幽靈工人」是否受到剝削。

當我們把機器訓練得更人性化時,是不是也在讓人類像機器一樣工作?

當人工智慧系統越來越多地控制生活的方方面面,這些工人究竟扮演著什麼角色呢?

在眾包平台中,最成熟的是亞馬遜土耳其機器人(Amazon Mechanical Turk,簡稱MTurk),由線上零售巨頭亞馬遜網路服務(Amazon Web Services)運營。

還有Samasource、CrowdFlower、Microworkers等其他公司。這些平台都允許企業遠距僱用來自世界各地的員工,來完成計算機目前無法完成的任務。

這些任務包括,標記圖像、幫助改進計算機視覺演算法、為自然語言處理提供幫助,甚至擔任YouTube或Twitter的內容主持人。

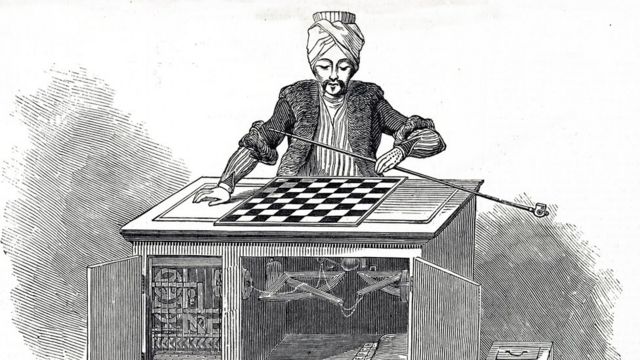

18世紀的土耳其機器人愚弄了國際象棋選手,讓他們以為自己在與一台機器競爭。

MTurk是以18世紀曾在歐洲巡演的國際象棋機器人命名的,但後來發現,這個機器的背後其實是人。

該平台在其網站上被標記為眾包市場,是「將機器學習開發的每一階段所需的成本和時間最小化的好方法」。

在這個平台上,下單者要求工作人員執行特定的任務。

亞馬遜網路服務的發言人表示:「大多數員工將MTurk視為兼職工作或有償愛好,他們享受可以選擇任務的靈活性,可以隨心所欲地加班,或者少量工作。」

但對於已經在這個平台工作了六年的謝莉·斯坦利(Sherry Stanley)來說,這更像是全職工作。這份工作幫助她在經濟上撫養三個孩子,也讓她覺得自己是巨大機器上的一個小齒輪。

她告訴BBC:「土耳其機器人是我在西弗吉尼亞為數不多的一個工作機會,和許多工人一樣,我們為自己的工作感到自豪。」

「但我們是亞馬遜一時衝動下的產物。亞馬遜是世界上最大的公司之一,需要像我這樣的員工對工作條件保持沉默。」

她說,如果說出自己被如何對待,就會一直活在「遭報復的恐懼中」。

很難描述斯坦利生活中的典型一天,因為正如她所說,「每天的工作時間都不一樣,工資也不一樣。」

這種工作的好處是,可以想做多少就做多少,也可以在家工作。

但她被要求完成的任務多種多樣,包括圖像標記、幫助智慧助手Alexa理解地區方言。

還有一系列她不理解的問題,比如:

- 為什麼有些工作(成果)被拒絶,花了很長時間的工人卻不被告知不符合標凖的原因?

- 為什麼有些帳戶突然被凍結,卻沒有任何通知,沒有或官方渠道來挑戰這種決定?

- 為什麼申請機構把一些項目的價格定得極低?

「土耳其機器人應該在我們的工作對象、內容、原因和地點等方面擁有更大的透明度:為什麼我們的工作(成果)被拒絶,這份工作到底在建設什麼,為什麼帳戶被凍結,不付費時數據去了哪裏,以及我們在為誰工作。」

Turkopticon是Mturk的工人擁有的最接近於工會的東西,這個組織正在努力讓工人們感覺不那麼隱形。

斯坦利表示:「Turkopticon是讓土耳其機器人變成組織的工具,讓他們就工作條件相互交流,並使工作變得更好。」

她正在籌集資金,以幫助該組織創建由工人操作的服務器,承包商可以在那裏討論工作條件。

亞馬遜回應BBC,它在2019年推出了一項功能,允許員工看到「下單者的活動水平、批准率和平均付款審核時間」。

它在一份聲明中說:「儘管工人的成果被下單者拒絶的整體率很低(小於1%),工人們也獲得了一組標凖,可以幫助他們確定想要的工作任務,包括下單者接受任務的歷史記錄。

「MTurk繼續幫助各種各樣的工人賺錢,並為他們社區的發展做出貢獻。」

YouTube禁令

在YouTube上,與LGBTQ相關的內容在沒有明顯原因的情況下被禁,但到底是演算法還是背後的人應該受到譴責呢?

賽飛·薩維奇(Saiph Savage)是西維吉尼亞大學人機交互實驗室的主任,她的研究發現,對於很多工人來說,工資可能低至每小時2美元,而且他們通常不知道需要在一個特定任務上工作多少個小時。

她在接受BBC採訪時說:「他們被告知,這份工作值5美元,但可能需要兩個小時。」

「僱主比工人擁有更大的權力,可以突然決定,否定工作(成果),而工人卻沒有辦法對此採取任何行動。」

她還表示,人們往往對這些平台上的員工是誰,以及他們的偏見是什麼知之甚少。

她引用了最近一項與YouTube有關的研究,該研究發現,演算法已經禁止了一些LGBTQ的內容。

「深究下去,並不是演算法有偏見,而是幕後的工作人員,他們在一個需要審查LGBTQ內容的國家工作。」

這種有關偏見的觀點是蒙特利爾人工智慧倫理研究所(Montreal AI Ethics Institute)的亞歷山大·羅耶(Alexandrine Royer)提出的,她寫道,迫切需要對這些員工進行更多監管。

她說:「數據工作者負責全球平台上的數據標籤和內容審核,非洲和其他地方的數據工作者做出的決策,反饋給了世界各地的互聯網用戶,並塑造了每天與之互動的演算法。」

「在數字經濟的陰影下工作,這些所謂的『幽靈工人』作為在線內容的仲裁者負有巨大責任。」

她還說,谷歌的搜索、推文、產品評論都依賴於這種「看不見的勞動力」。「我們早該監管並適當補償這些工人了。」